哎呀妈呀,还记得小时候看《黑客帝国》里头尼奥弯腰躲子弹那会儿不?整个电影院的人都快惊掉下巴了——时间咋就能说停就停,镜头还能围着人转圈圈看呢?那会儿觉得,这玩意儿肯定是好莱坞那些顶级大神们,守着价值连城的机器,花好几百万美金才整出来的魔术。可现在你再瞅瞅,刷个短视频,隔壁老王家的闺女都能用手机App给自己整个“时间静止”的小视频发朋友圈了。这翻天覆地的变化,到底是怎么发生的?今天咱们就捞点干的,好好唠唠这事儿,这篇特效技术解析文章,就想给你整明白,那些曾让人望尘莫及的视觉魔法,是咋一步步“飞入寻常百姓家”的-3。

一、 门槛塌方:AI入场,特效不再是“贵族游戏”

过去搞电影特效,那真是“有钱人的烧钱游戏”。一个顶级镜头,几十号艺术家吭哧吭哧干好几个月,从建模、贴图到动态模拟,流程复杂得能让人头皮发麻-3。钱呢?更是像烧纸一样。光是《阿凡达》里潘多拉星球上那些发光的植物和灵动的飞龙,背后就是海量的工时和天价渲染农场在支撑。普通影视团队甚至个人创作者?想都别想,连门都摸不着。

可这两年,情况彻底变了。搅动这池春水的,就是AI。它就像个突然闯进传统作坊的超级机器人,把很多重复、繁琐的“体力活”给包圆了。比如说搭场景,过去美术师得一根草一片叶子地手动建模,现在呢?你只要跟AI描述一下,比如“我想要一个赛博朋克风格的下雨街巷,霓虹灯牌要倒映在湿漉漉的地面上”,AI就能通过学过的海量图像,吭哧吭哧给你生成一个基础三维场景,艺术家只需要在此基础上做精细调整和艺术加工就行,效率那是蹭蹭往上涨-3。

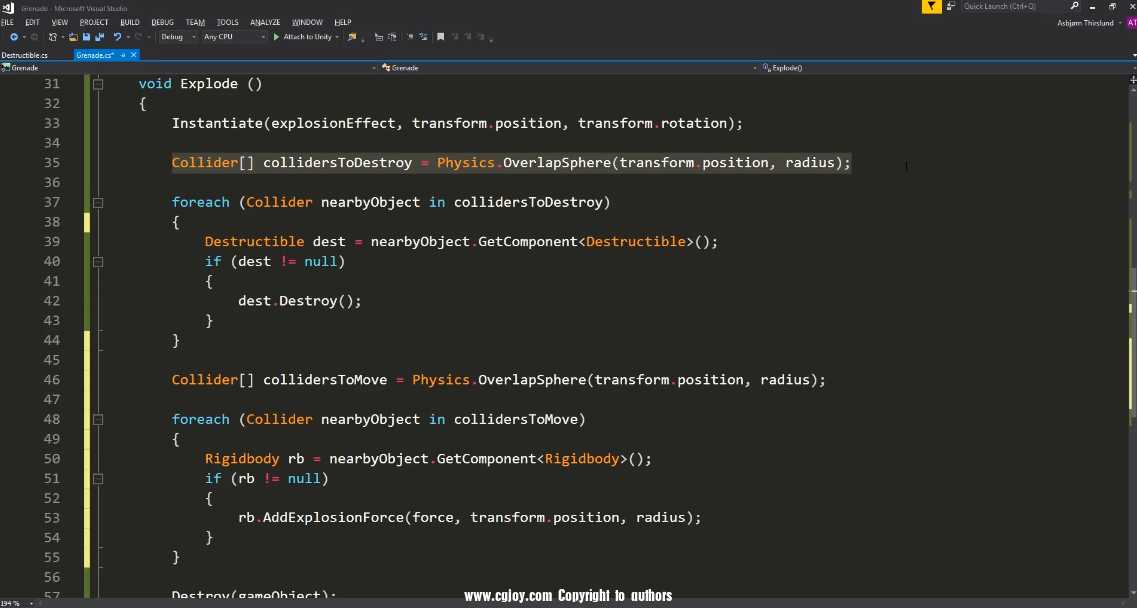

更绝的是渲染和动作捕捉这些核心环节。传统渲染一帧高清图,电脑得吭哧吭哧算好几个钟头,而AI能聪明地分析场景,知道哪里是视觉焦点,就在哪里用最高质量渲染,背景区域则智能优化,在保障效果的同时把时间成本打下来-3。以前做虚拟角色,得让真人演员穿紧身衣贴满感应点(动作捕捉服),动作数据还老因为遮挡出问题。现在AI能综合分析多路数据,自动把缺失的动作给补上,连现实中不存在的怪物该怎么动,它都能参考动物运动规律给你生成个八九不离十的方案-3-6。

这么一整,效果立竿见影。像《哪吒2》里,那密密麻麻的“星云鱼群”场景,用传统方法做得做几个月,引入AI辅助后,周期缩短到了几周;片中申公豹和哪吒空中对打的复杂动作,用AI模拟物理引擎来生成,成本据说只有老方法的五分之一-6。你看,AI这一通操作,不光是省时省钱,它简直是把特效制作高高在上的门槛给“炸塌了”,让更多有创意但没巨资的团队和个人,也有了触碰高端视觉表达的入场券。

二、 魔法拆解:那些让你“哇塞”的名场面是咋来的?

门槛低了,但咱们观众的眼睛可更刁了。普通的特效已经不过瘾,大家还是爱看那些能带来极致体验的“名场面”。别急,这些魔法现在也有了指北针,能被咱们看懂了。

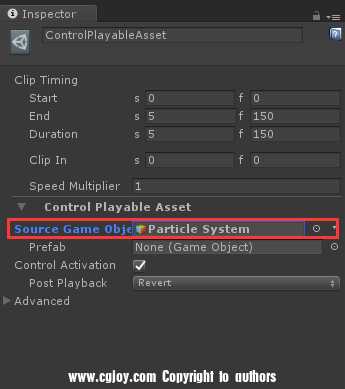

就拿最经典的“子弹时间”来说吧。它的核心秘密根本不是一台摄像机搞定的,而是一套精密到变态的“多摄像机阵列系统”。想象一下,几十甚至上百台相机,像军训一样被精确排布在弧形轨道上,把拍摄对象围在中间。一声令下,所有相机以毫秒级的精度依次“咔嚓”,每个相机只捕捉那么一瞬间的一个角度。最后把这些瞬间连起来播放,就成了镜头围绕静止(或超慢速)物体旋转的奇迹-1。这里头的难点,一是所有相机得绝对同步,差一丁点流畅感就完蛋;二是它们的色彩、曝光参数得像克隆出来的一样一致,不然画面跳来跳去能把你眼睛看花-1。现在一些技术平台,正在研究用强大的实时网络传输能力,试图让这种特效也能在直播互动中实现,那可是更难的技术挑战了-1。

再说说“慢动作”。你以为只是把视频播放速度拉慢就行?太天真啦!真正的优质慢动作,奥秘在于前期用超高帧率去拍。普通视频一秒记录30帧画面,如果你用120帧每秒去拍,放到30帧的流里播放,自然就得到了4倍的丝滑慢放-1。帧率越高,能慢放的倍数就越大,画面也越顺滑。专业高速摄像机能达到每秒数千甚至上万帧,连子弹击穿水果的瞬间、水滴皇冠的绽开都能给你看得清清楚楚-1。当然,高帧率对光线要求极高,数据量也爆炸,这都是甜蜜的负担。

还有那些让你身临其境的虚拟世界,比如《阿凡达》里的潘多拉星球,《少年派的奇幻漂流》里梦幻的海洋,背后站着一位大功臣——数字光学技术。它不仅能构建出极其逼真的三维场景和生物-4,更厉害的是对光影的掌控。它能精准模拟阳光穿过树叶投下的斑驳光影、物体表面的复杂反射折射,甚至爆炸时火光冲天的复杂光效-4。这项技术把光影从“打灯照明”变成了“用光作画”,是营造沉浸感不可或缺的画笔。

你看,把这层神秘面纱一揭,这些酷炫特效是不是也没那么“玄乎”了?它们都是靠扎实的技术原理和巧妙的工程智慧堆砌起来的。而这恰恰是第二篇特效技术解析文章要带给你的核心价值:它不光是告诉你“是什么”,更深入剖析“为什么”和“怎么做到”的,让你从看热闹的观众,变成懂门道的鉴赏者-1-4。

三、 未来已来:实时化、交互化与中国技术的“弯道超车”

聊完了现状,咱再把眼光往前瞅瞅。特效技术的未来,可不是把电影级效果搬到手机那么简单,它正朝着更激动人心的方向狂奔。

第一个大趋势是实时化与交互化。传统的电影特效属于“离线渲染”,拍完慢慢算,算几个小时一帧是常事。但现在,游戏引擎技术被引入影视制作,带来了“实时渲染”的革命。导演在LED巨幕环绕的虚拟片场里,能当场看到主角在奇幻森林里的样子,光影效果实时呈现,可以立刻调整-9。这意味着创作从“后期漫长等待”变成了“现场即时决策”,流程被彻底重塑-7。未来,配合VR、AR设备,观众或许能自由切换观看电影的视角,甚至影响剧情发展,特效将从“预设的视觉奇观”变为“可交互的体验核心”。

第二个趋势,是中国自主创新技术正在快速崛起,试图实现“弯道超车”。比如中国自主研发的“菁彩Vivid”HDR视频和三维声技术标准。它能让画面亮度提升40倍,色彩丰富度增加70%,声音也具备三维空间感-9。这可不是简单的参数提升,而是试图从技术标准的底层,定义下一代视听体验。更振奋人心的是,这项技术正随着中国电影“出海”,走向全球市场-9。这意味着,未来我们不仅能用中国技术讲好中国故事,还可能让全球观众通过中国标准的技术窗口,来感受东方美学的独特魅力。

所以你看,未来的特效技术解析文章,其内涵必然将再次扩展。它不仅要继续拆解那些更新、更炫的视觉魔法(比如可能普及的实时全息影像),更需要深入探讨技术如何与艺术更深层地融合,以及像中国“菁彩Vivid”这样的自主标准,如何在全球科技文化竞争中开辟新赛道-9。技术不再是艺术的附庸,它正在成为塑造艺术语言、甚至定义文化输出方式的核心驱动力。

唠到最后

说到底,从《黑客帝国》到手机短视频,特效技术的民主化历程,其实就是一部技术不断赋能创意的历史。AI降低了技术的硬门槛,让创意得以解放;数字光学、实时渲染等技术不断拓展着表达的边界;而自主创新的前沿探索,则在为我们争夺未来视觉话语权。

技术或许会变得越来越复杂高深,但它服务的终极目标始终没变:更好地实现人类那些天马行空的想象,更动人地讲述我们内心澎湃的情感。下一次,当你在影院为浩瀚宇宙惊叹,或是在手机前被一个创意特效短片逗乐时,或许能会心一笑,因为你知道,支撑这一切的,不再是遥不可及的魔法,而是人类智慧凝结而成的、不断进化的技术诗篇。而这,正是所有深入、真诚的特效技术解析文章,最终想要传递给你的温度与洞察。