如果你辛辛苦苦写的论文,被系统判定为“AI生成”;或者你精心训练的大模型,在某个标准测试上表现惊艳,一到实际业务却漏洞百出——你正在经历的,就是当前AI评估领域最典型的混乱与困境。从学术界到工业界,如何准确评估AI的能力与输出,已经成了一场充满误判、博弈和不确定性的“猫鼠游戏”。而一种更系统、更智能的评估思路——“AI亚测”,正在成为破局的关键。

AI检测,为何频频“翻车”?

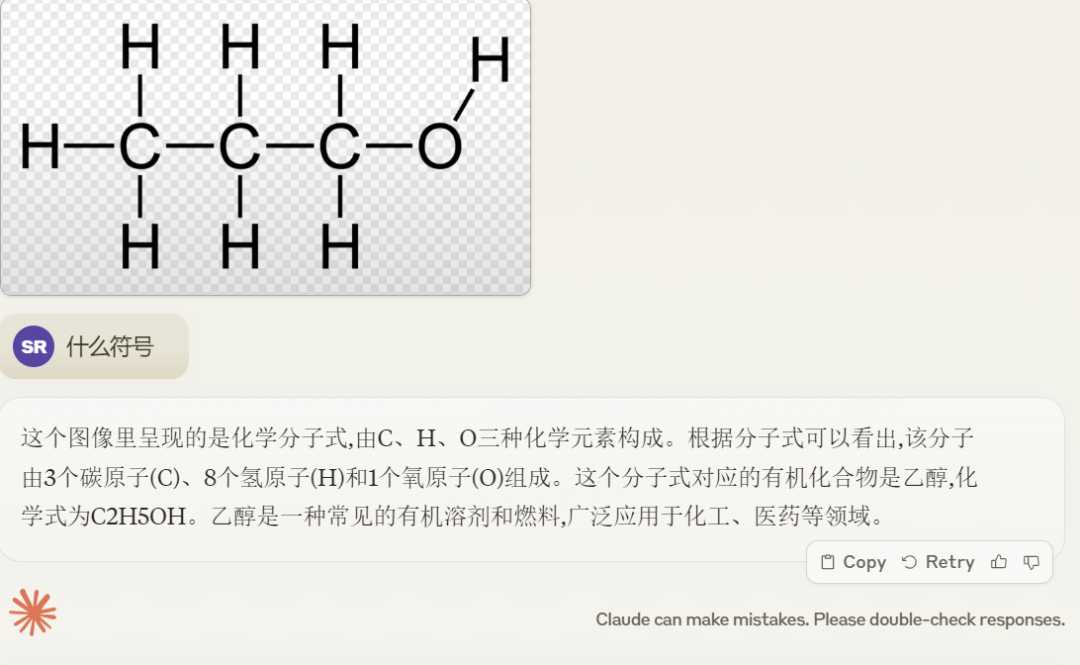

当前的AI内容检测,常常陷入一种尴尬的悖论。一方面,为了防范学术不端或虚假信息,各类检测工具被广泛应用,甚至出现用“AI率”对论文一票否决的极端情况-2。另一方面,检测技术本身却漏洞百出。有高校教师发现,研究团队耗时3年扎根基层写出的真实案例段落,竟被系统标红为“高度疑似AI生成”-2。更令人啼笑皆非的是,连朱自清的经典散文《荷塘月色》被上传至某检测系统后,也显示“总体疑似度超过六成”-2。

这种普遍误判的根源在于,许多检测工具的底层逻辑存在先天缺陷。它们本质上是通过分析文本的词汇频率、句式结构等表面特征,与已知的AI生成内容进行匹配-2。追求逻辑严谨、表达规范的学术写作,其特质本身就与AI的“行文风格”高度重合-2。这就好比仅凭一个人说话是否条理清晰来判断他是不是机器人,自然会错漏百出。

这种“宁可错杀”的粗暴检测,催生了一个扭曲的产业链:学生们不再专注于提升研究质量,而是钻研如何通过删减连接词、打乱段落结构等“秘籍”来降低AI率-2。这最终导致文本质量下降,与教育和学术追求的初衷完全背道而驰。显然,依赖单一、僵化的检测指标,已经造成了新的问题。

超越表面:AI亚测的核心是系统性评估

面对上述乱象,“AI亚测”代表了一种截然不同的思路。它不是一个简单的“是或否”的检测器,而是一个系统化、多层次的模型评估与内容分析框架。其核心目标不是武断地贴标签,而是深入理解AI模型的真实能力边界及其生成内容的本质。

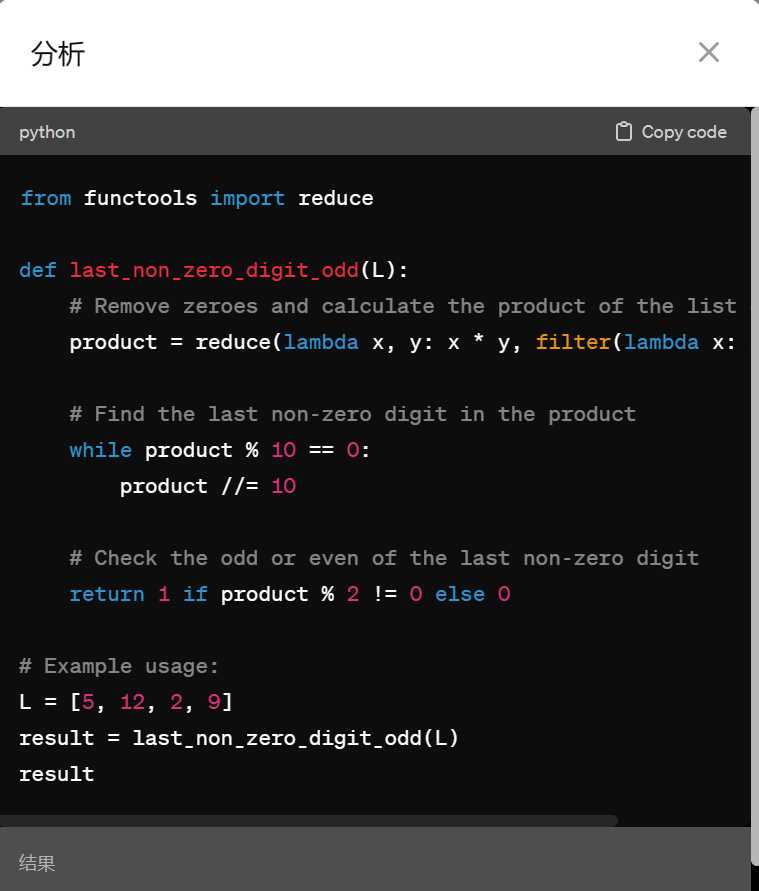

真正的专业评估,远非一个分数所能概括。例如,在评估一个大型语言模型时,专业的AI亚测流程会涵盖多个维度:从测试其对时事知识的掌握程度,到考察其分步骤解决数学问题的推理能力;从检查其根据特定风格进行写作的遵循度,到验证其生成可运行代码的实践能力-1。这就像考核一个学生,不能只看单项选择成绩,还要看他的论文、实验和创造力。

更重要的是,有效的评估必须与特定场景紧密结合。一个在通用诗歌创作基准上得分不高的模型,可能在生成合规的法律文书方面表现卓越-1。AI亚测强调构建属于自己的、贴近实际业务需求的测试集。因为厂商公开的基准测试,很可能已被模型“针对性训练”过,就像学生刷透了历年考题,其高分并不能完全代表解决全新问题的能力-1。企业自己内部的测试数据和方法,才是评估模型是否“好用”的真正试金石。

动态博弈:当评估遇上“反检测设计”

在现实世界中,AI的评估还面临一个更复杂的挑战:对手方会有意地修饰和伪装AI生成的内容,以通过检测。这就使得最前沿的AI亚测,必须将“反检测设计”纳入考量,进行动态的对抗性测试。

网络上已经流传着各种欺骗检测器的“秘籍”,例如故意增加拼写错误来模仿未经仔细校对的人类手稿,或者刻意调整句子长度的变化(增加“突发性”)以使行文节奏更似真人-5。更进一步的,还包括使用特定的提示词,要求模型在写作时“参考情感事件,使用详细的现实生活经验作为例子”,从而为文本注入更具象、更个人化的细节,绕过基于统计特征的检测-8。

高水平的AI亚测,必须能识破这些伪装。这要求评估系统不能只停留在语法层面,而要能进行更深层的语义和逻辑一致性分析。例如,一个看似充满个人感受的段落,其内在的情感逻辑是否真实?所引用的“生活细节”是否经得起常识推敲?这正是当前检测技术需要突破的瓶颈:从寻找表面“指纹”,转向洞察内容的内在合理性。

业界领先的研究方向也印证了这一点。例如,南开大学的研究团队提出了“直接差异学习”方法,旨在让检测模型学习人类与AI文本之间更深层的语义差异,而不是死记硬背表面特征,从而大幅提升了对新型、未知AI模型的泛化检测能力-9。这种能够“举一反三”的检测思维,正是AI亚测体系所追求的高级形态。

构建你自己的AI亚测能力

对于企业和开发者而言,构建实用的AI亚测体系,可以从一些务实的步骤开始:

明确核心用例:首先想清楚,你主要用AI来做什么?是客服对话、代码生成、营销文案还是数据分析?你的测试应紧紧围绕这些核心任务展开-1。

设计场景化测试集:收集或创建一批针对你业务场景的测试问题或任务。确保它们具有足够的挑战性和代表性,并能覆盖正常、边界和异常情况。

建立多维评估标准:不要只用一个“正确率”。对于生成式任务,可以从相关性、准确性、流畅性、安全性等多个维度制定评分标准-4。对于客观题,可以分析其推理过程;对于主观题,可以制定详细的评分指引-4。

进行交叉验证与对抗测试:用不同的主流模型(如GPT、Claude、Gemini等)同时运行你的测试集,对比结果-1。同时,可以尝试用前文提到的“反检测”手法稍加修饰AI的答案,看看你的评估标准是否仍然稳健。

实现流程工程化:当评测变得频繁复杂时,就需要将其平台化、自动化。这包括统一的模型接入、标准化的评分协议、可视化的结果对比以及历史追溯能力,将评测从手工劳动转变为可管理的工程实践-7。

未来趋势:从被动检测到主动治理

展望未来,AI评估的发展将超越简单的“检测”,走向全面的“治理”。AI亚测的终极形态,将是与AI开发和应用流程深度嵌合的智能质量保障体系。例如,在自动化测试领域,AI已能直接阅读需求文档,自动生成数百条覆盖各种场景的测试用例,并将自然语言指令转化为可执行的测试动作-10。这揭示了一个方向:评估AI的,最终将是更高级、更全面的AI系统。

同时,随着大模型能力的飞速进化,静态的测试集很快就会过时。未来的AI亚测平台必须具备持续学习和演进的能力,能够根据模型的新能力和潜在风险,动态更新评估维度与测试方法。评估的目的也将从单纯的“排名”和“筛选”,转向更深度的“能力诊断”和“风险预警”,为AI的安全、可靠、负责任的应用提供核心支撑。

在这场人类与AI智能不断加深的互动中,粗糙的检测只会制造对立和噪音。而像AI亚测这样,致力于深入理解、系统评估和动态博弈的务实方法,才是我们驾驭技术、释放其真正价值的明智之选。毕竟,我们的目标不是恐惧或排斥AI的产出,而是学会如何与之共舞,并始终确保舞步的主动权,牢牢掌握在人类手中。