唉呀,我跟你说,以前做个变形效果真是能把人逼疯。就拿我那个做平面设计的朋友来说,他想把一行标题文字弄成波浪形,在传统软件里得一个个锚点调,调完左边右边对不齐,调完上边下边又歪了,搞一个下午最后效果还像虫子爬过一样。现在呢?用可灵AI这样的工具,直接选个“波浪形”预设,几秒钟就出来效果,参数滑块拉一拉,实时预览看着调,那种畅快感,真是“解放了生产力”-1。这背后的ai扭曲形状技术,解决的第一个大痛点就是把设计师从繁琐、重复且需要极高手工技巧的机械劳动中解放出来,让你能把心思真正花在创意和构思上,而不是和软件工具“搏斗”-1-9。

不过,设计的世界可不止是平面。咱们跳到3D和更专业的领域,那“扭曲”的难度和需求更是上了几个台阶。比如,服装设计师想知道一件衣服穿在不同高矮胖瘦的模特身上是啥样,总不能每个尺寸都做件样衣吧?以前这几乎无解,现在AI来了。谷歌的研究团队搞了个叫TryOnDiffusion的模型,它厉害就厉害在能理解服装的“本质”-2。你给它一张衣服图和一张人物图,它不仅能给人物“穿上”这件衣服,还能根据人物的姿势、身材,对衣服进行非常合理的ai扭曲形状处理——该拉伸的地方拉伸,该褶皱的地方生成褶皱,仿佛这件衣服就是为这个身材量身剪裁的一样-2。这对于服装电商、虚拟试衣来说,简直是革命性的,解决了样品制作成本高昂和用户体验单一的痛点。

还有更神的,你想直接修改一张产品设计图片中某个部件的形状和大小,比如把一张椅子照片的椅背调高或者把腿变粗。按照老办法,你得有这张椅子的3D模型,在专业3D软件里改好,再重新渲染出图,流程长得吓人。现在,像StylePart这样的AI框架,玩的是“降维打击”-3-7。它通过一个巧妙的“形状一致潜在映射函数”,把你拍的2D图片“翻译”到3D形状的属性空间里。在那个空间里,修改部件尺寸、替换部件就像搭积木一样直观。改完之后,再“翻译”回2D图片空间,一张修改后的逼真图片就生成了-7。用户完全不用接触任何复杂的3D建模流程,就能实现精准的部件级形状操控,这为产品设计、创意表达打开了新世界的大门。

看到这里你可能会想,这些AI能力未来会变成啥样?根据智源人工智能研究院发布的2026年趋势,AI正在发生一个根本性转变:从“预测下一个词”转向“预测世界的下一个状态”-4。什么意思?就是说,未来的AI不再只是理解语言或者识别图像,它开始试图理解我们物理世界的运行规律和逻辑。把它套用到ai扭曲形状这件事上,意味着未来的变形将更加智能和符合物理规律-4-8。比如,你让AI把一张平静湖面的图片“扭曲”成波涛汹涌的样子,它不仅能改变水的形状,还能自动为你生成符合力学规律的波浪、飞溅的水花、以及光线在水面上的反射变化,整个画面动态自洽,就像真实世界会发生的一样。这解决的是创意实现中“真实感”和“合理性”的终极痛点,让天马行空的创意都能找到科学而美观的落脚点。

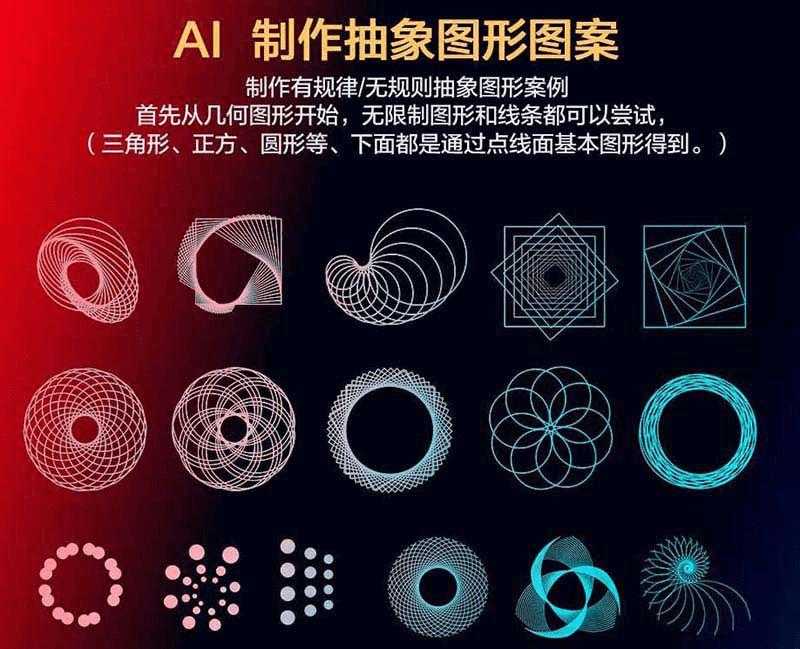

那咱们普通人现在能怎么利用这些工具呢?其实门槛比你想象的低得多。如果你有点设计基础,可以尝试用AI工具生成复杂图案基底。就像火星时代那个教程里说的,在AI软件里用个六边形,在“效果-扭曲和变换”里调调缩放、旋转和副本参数,瞬间就能生成意想不到的复杂放射状线条图形,这靠自己手画简直不可想象-9。然后把这个线条图丢到PS里去加渐变、做模糊,光影层次一下子就出来了。这个组合拳打下来,效率提升不是一星半点。

对于完全不想碰专业软件的朋友,现在也有“傻瓜式”的AI变形工具。比如Dreamina的变形动画工具,你做动画再也不需要一帧一帧画了-10。你就找两张图,一张是起点(比如一颗种子),一张是终点(比如一棵大树),上传上去,AI自动就能生成中间种子破土、发芽、生长、成树的整个平滑变形动画过程-10。这种“两帧变大片”的能力,让视频创作、内容表达的门槛急剧降低,普通人也能做出电影级别的转场特效。

所以说,无论是专业设计师还是业余爱好者,AI在形状扭曲和生成上的能力,已经实实在在地变成了我们的“超能力外挂”。它把我们从技术的泥潭里拉出来,推着我们往创意和想象力的更深处奔跑。以前绞尽脑汁也“整不明白”的效果,现在可能只是一次聪明的提问或几次点击。这个过程,本身就像一场充满惊喜的变形记,而我们,都是这场变革的见证者和参与者。