还记得《侏罗纪公园》里第一次看到恐龙时的那种震撼吗?或者说,最近刷短视频时,看到有人随手把自家客厅变成海底世界,一条鲸鱼从沙发后缓缓游过?从好莱坞大片到手机小屏,那些曾经遥不可及的酷炫效果,正以前所未有的速度“飞入寻常百姓家”。这背后,正是一系列动态影视处理技术在疯狂进化,它们就像是给视频创作者的一对翅膀,让天马行空的想象能直接“着陆”成生动的画面-2。

过去搞特效,那真是费老劲了。你得有昂贵的绿幕棚、专业的跟踪设备,艺术家们一帧一帧地抠像、匹配运动,工期漫长,成本高得吓人。但现在,情况不一样喽。最新的技术突破,比如像DynVFX这样的系统,玩出了一个新花样:你只需要一段现成的实拍视频,然后用大白话告诉它你想加什么,比如“在街角加一个会喷火的龙”,它就能自己琢磨着把龙“画”进去,而且喷火的动画、影子、甚至龙与周围环境的互动(比如火光映在墙上),都能给你安排得明明白白-2。这可不是简单的贴图,而是AI真正理解了场景的空间、光影和动态,让添加的物体“长”在了视频里。这对于头疼于复杂CG流程的小团队和独立创作者来说,简直就是“救命稻草”,极大地降低了动态视觉创作的门槛。

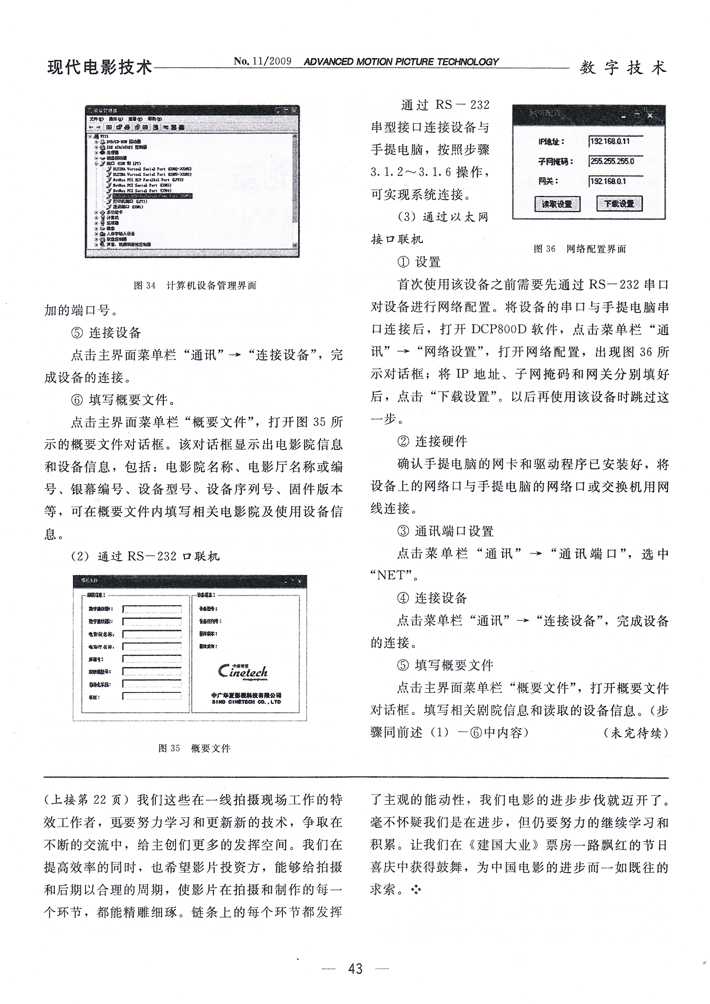

动态影视处理技术,解决的远不止是“从无到有”的添加问题,更是“从有到优”的修复与增强难题。很多人都有这样的痛楚:珍藏的老视频模糊掉帧、手机拍的夜景满是噪点、AI生成的动画动作卡顿……这些“先天不足”的素材,往往让人有心无力,直接弃用又不甘心。好在,技术同样给出了答案。例如阿里开源的Vivid-VR工具,它就像个全能的“视频老中医”,专治各种画质“不服”-3。它结合了先进的生成模型和控制网络,不仅能智能补帧让动作丝般顺滑,还能深度理解视频内容,修复模糊的纹理、降噪,甚至提升分辨率。另一边,云渲染服务商推出的AI插帧黑科技,则从另一个角度切入:它允许制作方只渲染一部分关键帧,然后由AI智能预测并生成出高质量的中间过渡帧,这能直接让动画和特效的渲染工作量砍掉一大半,既省时间又省钱-9。以前那种因为渲染资源不够导致项目“整段垮掉”的风险,现在被大大降低了。

更让人兴奋的是,动态处理正在从“后期”大步流星地走向“实时”。这在过去简直是天方夜谭,但现在,在虚拟制片的片场里,导演和摄影师已经能通过LED巨幕,实时看到最终合成的画面。演员在蓝幕前表演,身后屏幕里却是实时渲染、并随着摄影机移动而正确变换视角的奇幻场景-7。这种“所见即所得”的模式,彻底改变了创作流程。导演能当场拍板,演员也能获得更真实的反馈,后期合成的很多猜疑和返工都省了。甚至有研究实现了超高速的实时相机轨迹优化算法,处理速度能达到每秒上千帧,这让大型赛事的直播也能轻松玩转电影里才有的“子弹时间”环绕视角,让“村BA”的精彩扣篮也能拥有巨星级别的视觉呈现-4-6。动态影视处理技术的这种实时化能力,正把影视工业的流水线,从串联改为并联,大大加速了创意落地的进程。

这项技术的“终极形态”会是啥样?答案或许藏在“体积视频”里。你可以把它理解成不是“拍”了一个平面视频,而是用无数个摄像头“扫描”出了一个动态的、三维的、活生生的数字模型-5。浙江大学等团队的研究,已经能让这种数据量原本巨大的体积视频,变得小巧到能在手机上流畅播放-5。这意味着,未来我们回顾一段家庭录像时,可能不再是在屏幕前“旁观”,而是能戴上眼镜,直接“走进”当时的场景里,从任意角度观察和回味。这已经不是简单的处理画面了,而是在重建和复现一段动态的记忆本身。

所以啊,从用一句话生成特效,到把模糊的老片修复如新,再到实时合成和构建三维动态世界,动态影视处理技术正在各个维度上重塑我们记录和创作影像的方式。它不再只是顶级制片公司的秘密武器,而是逐渐变成了每一个有故事想讲述、有创意想表达的普通人工具箱里的得力助手。技术的普惠,最终让视觉表达的门槛一降再降,也让这个世界的精彩,有了更多被生动呈现的可能。未来已来,而动态的视界,正变得越来越清晰,也越来越触手可及。